A premissa básica da imagem eletrônica é que a energia da luz é convertida em eletricidade de uma forma que preserva a informação visual, permitindo-nos reconstruir as propriedades ópticas de uma cena. Essa interação previsível entre fótons e elétrons inicia o processo de captura de imagens digitais. Depois que a energia fornecida pelos fótons incidentes é convertida em energia elétrica, o sistema deve ter alguma maneira de quantificar essa energia e armazená-la como uma sequência (ou matriz) de valores.

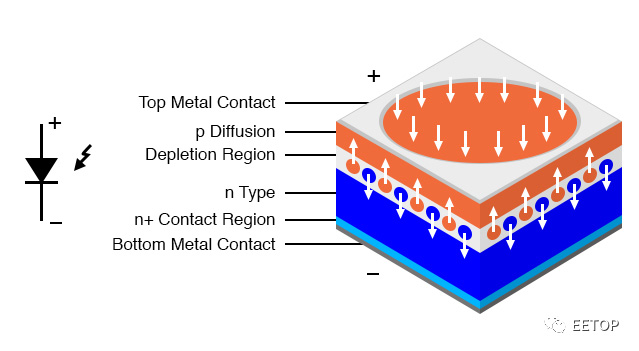

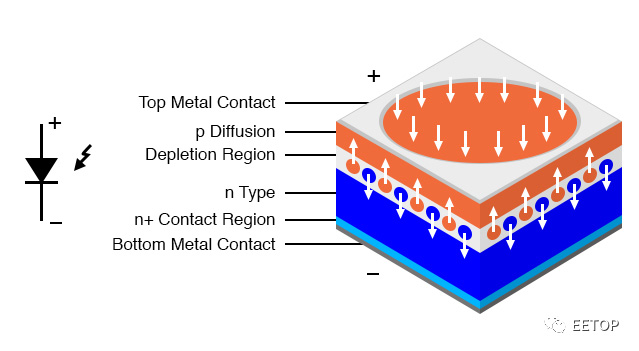

Na maioria dos sensores de imagem, a conversão de luz em eletricidade é feita por um fotodiodo, que é uma junção PN cuja estrutura favorece a geração de pares elétron-buraco em resposta à luz incidente.

Os fotodiodos são geralmente feitos de silício, mas outros materiais semicondutores, como arsenieto de índio, antimoneto de índio, telureto de cádmio de mercúrio, etc., também são usados para vários fins especiais.

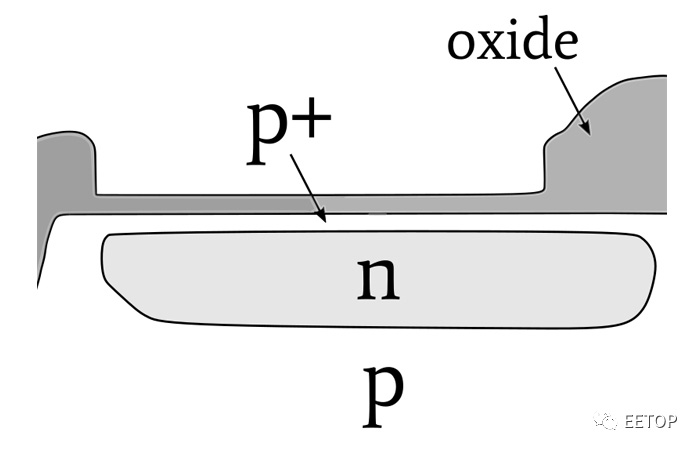

Um avanço importante na tecnologia de sensor de imagem foi a criação de um fotodiodo do tipo fixado. Na imagem acima, um fotodiodo, como um diodo normal, consiste em uma região do tipo p e uma região do tipo n.

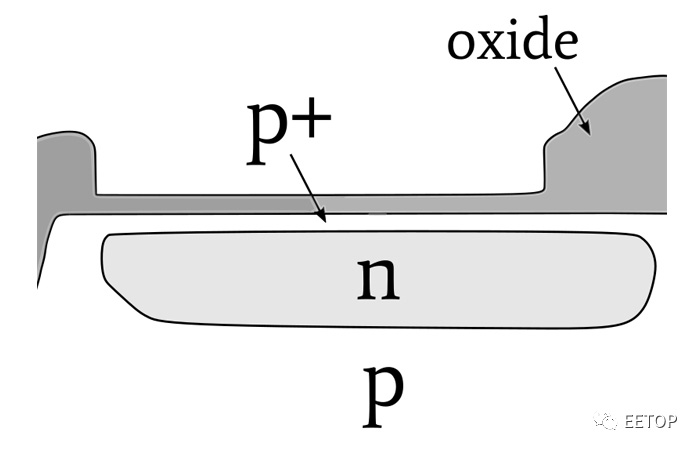

Os fotodiodos do tipo preso têm uma região adicional feita de semicondutor do tipo p altamente dopado (p para abreviar); como mostrado, é mais fino do que as outras duas regiões.

Esta figura mostra a estrutura de um fotodiodo fixado integrado em um sensor de imagem

Introduzido na década de 1980, os fotodiodos Pinned resolveram o problema (chamado de "histerese") associado à transferência retardada de carga gerada pela luz. Os fotodiodos de estilo fixado também oferecem maior eficiência quântica, melhor desempenho de ruído e menor corrente escura (retornaremos a esses conceitos mais tarde nesta série).

Hoje, o elemento fotossensível em quase todos os sensores de imagem CCD e CMOS é um fotodiodo preso.

As duas principais tecnologias de imagem são CCD (Charge Coupled Device) e CMOS.

Existem também outros tipos de sensores, como sensores NMOS para espectroscopia, fotômetros em miniatura fornecendo sensibilidade de imagem térmica infravermelha e aplicações especiais podem usar matrizes de fotodiodo conectadas a circuitos amplificadores personalizados.

No entanto, vamos nos concentrar em CCD e CMOS. Essas duas categorias gerais de sensores cobrem uma ampla gama de aplicações e funções.

Parece que as pessoas são atraídas pelo julgamento de valor de "Qual é melhor?" Perguntas como montagem de superfície ou buraco? BJT ou FET? Canon ou Nikon? Windows ou Mac (ou Linux)? Essas perguntas raramente têm respostas significativas e até mesmo comparar características individuais pode ser difícil.

Então, o que é melhor, CMOS ou CCD? A comparação tradicional é assim: o CCD tem menor ruído, melhor uniformidade de pixel a pixel e tem uma reputação de qualidade de imagem superior. Os sensores CMOS oferecem níveis mais altos de integração-reduzindo a complexidade para projetistas de circuitos-e menor consumo de energia.

Não estou dizendo que essa avaliação é imprecisa, mas sua utilidade é limitada. Depende muito de suas necessidades de sensores e seus requisitos e prioridades.

Além disso, a tecnologia está mudando rapidamente, e a grande quantidade de dinheiro investida em pesquisa e desenvolvimento de imagem digital pode mudar gradualmente o padrão de CCD e CMOS.

Em segundo lugar, os sensores de imagem não produzem imagens. É parte integrante de um sistema de imagem digital (uma parte muito importante, é claro), e a qualidade da imagem percebida produzida pelo sistema depende não apenas do sensor, mas muitos mais fatores. Não há dúvida de que os CCDs superam os sensores CMOS para algumas propriedades optoeletrônicas. Mas associando um CCD com maior geralQualidade da imagem parece um pouco irracional.

Considerações de design do sistema

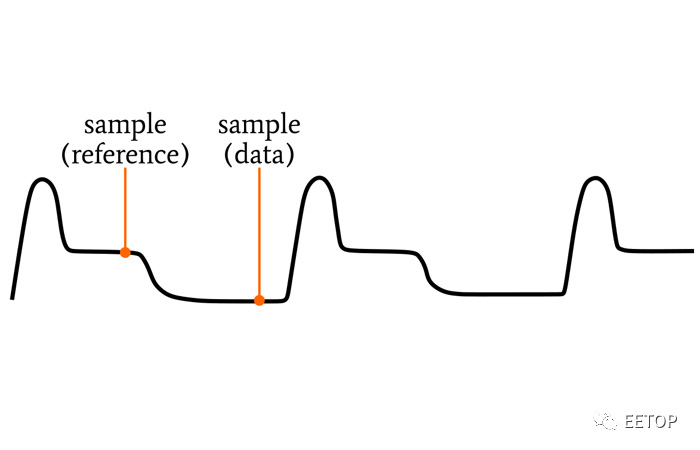

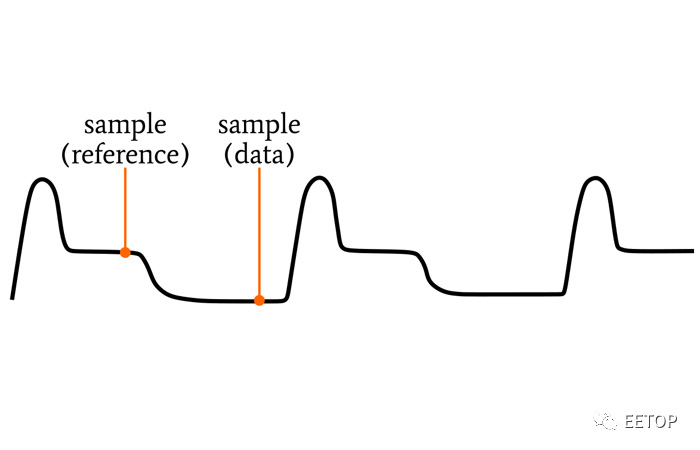

Um sistema baseado em sensor CCD requer um grande investimento em design. Os CCDs requerem uma variedade de potência de nível não lógico e tensões de controle (incluindo tensões negativas), e o tempo que deve ser aplicado ao sensor pode ser muito complexo. Os "dados" de imagem produzidos pelo sensor são uma forma de onda analógica que precisa ser finamente amplificada e amostrada e, é claro, qualquer processamento de sinal ou circuito de conversão de dados tem o potencial de introduzir ruído.

O baixo desempenho de ruído começa com um CCD, mas não termina aí-devemos nos esforçar para minimizar o ruído em toda a cadeia de sinal.

Forma de onda de saída CCD

A situação é bem diferente para os sensores de imagem CMOS. Eles funcionam mais como circuitos integrados padrão, com fontes de tensão em nível lógico, processamento de imagem no chip e dados de saída digital. Você também pode ter que lidar com algum ruído de imagem adicional, mas em muitas aplicações este é um pequeno preço a pagar para reduzir muito a complexidade do projeto, custo de desenvolvimento e estresse.

O processamento de imagem não é uma tarefa típica de microcontrolador, especialmente quando você está trabalhando com alta taxa de quadros ou sensores de alta resolução. A maioria dos aplicativos se beneficiará do poder de computação de um processador de sinal digital ou FPGA.

A compressão também precisa ser considerada, especialmente se você precisar armazenar imagens na memória ou transferi-las sem fio. Isso pode ser realizado por software ou hardware programável.

English

English 日本語

日本語 한국어

한국어 français

français Deutsch

Deutsch Español

Español italiano

italiano русский

русский português

português العربية

العربية tiếng việt

tiếng việt ไทย

ไทย čeština

čeština dansk

dansk Svenska

Svenska